El uso del reconocimiento facial ha llegado para quedarse. Hay que evitar que se convierta en otra herramienta más de vigilancia masiva.

Ten cuidado, me he quedado con tu cara. Hace más de 70 años, George Orwell relató la historia Winston Smith y Julia tratando de escapar de un sistema donde la intimidad era algo prohibido y donde “el gran hermano” lo vigilaba todo.

La novela, 1984, se convirtió en un presagio de lo que hoy es una realidad: el reconocimiento facial.

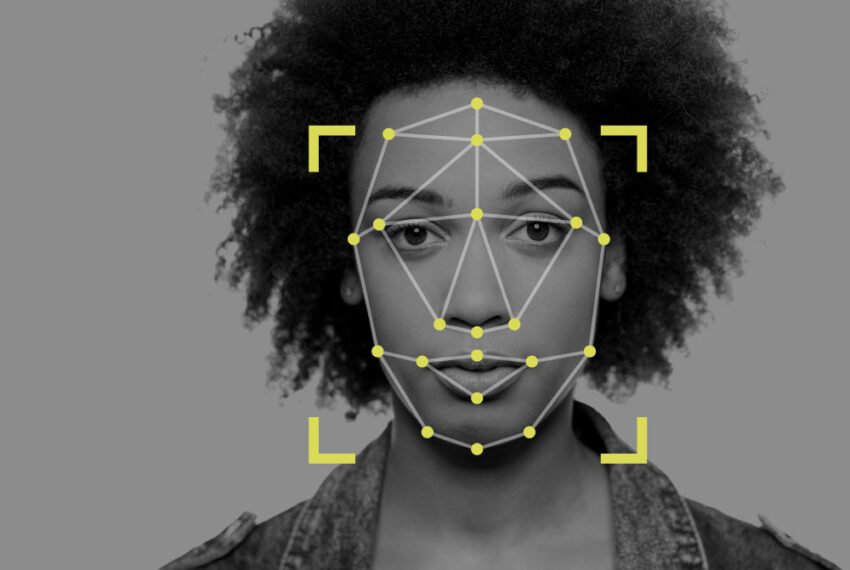

Vivimos en una sociedad en la que sistemas informáticos de última generación son capaces de identificar a una persona basándose en imágenes o vídeos de las cámaras que inundan nuestras ciudades y asociar su rostro a bases de datos preexistentes, como las de la policía, por ejemplo

Además de analizar nuestros hábitos de consumo, los lugares que visitamos, nuestras publicaciones en redes sociales, etc.

Esta tecnología, usada con fines de identificación, constituye una modalidad de vigilancia masiva, y por consiguiente, una violación del derecho a la privacidad. La vigilancia indiscriminada a la gente no tiene justificación.

El uso de tecnologías biométricas está aumentando en todo el mundo a gran velocidad; un uso que plantea riesgos para los derechos humanos, como el derecho a la privacidad o la libertad de expresión, entre otros.

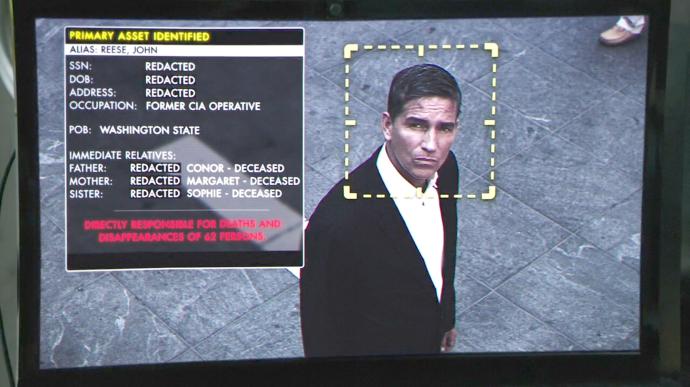

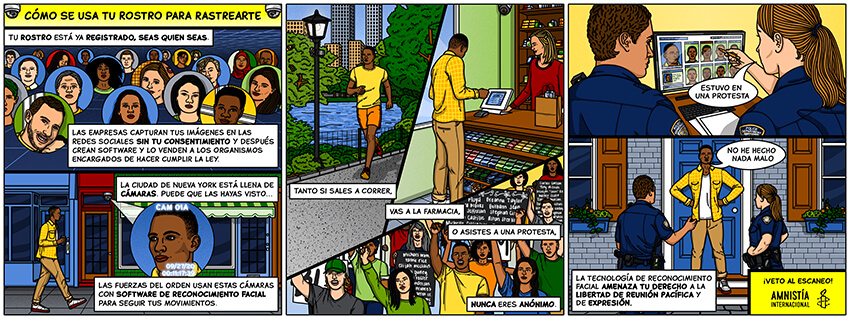

En varios países, como por ejemplo Estados Unidos o China, la policía utiliza el reconocimiento facial para localizar a personas que participan en manifestaciones, mediante imágenes capturadas a través de circuitos cerrados de televisión (los famosos y omnipresentes CCTV) y otros dispositivos de videovigilancia.

Esas imágenes se procesan mediante programas que analizan y buscan posibles coincidencias de rostros con una base de datos designada.

Una de las mayores preocupaciones que suscita la tecnología que se queda con tu cara es que se utilice contra las comunidades marginadas

Y no estamos hablando de una improbable sociedad distópica como la creada por la imaginación de George Orwell.

El pasado 7 de agosto, en plena ebullición del movimiento Black Lives Matter, tras una presunta agresión a un agente al gritar por un megáfono el 14 de junio.

De repente decenas de agentes de la policía de Nueva York intentaron entrar en el apartamento de Derrick “Dwreck” Ingram con intención de detenerlo, en una acción que recuerda otra distopía. La detención del protagonista de Matrix, Neo, por parte de las “fuerzas de seguridad”.

Durante cinco horas, la policía utilizó un helicóptero y drones, apostó a decenas de agentes con perros policías en el pasillo del edificio, en la salida de incendios y en edificios próximos, amenazó con echar la puerta abajo, no informó a Dwreck de sus derechos e intentó interrogarlo sin la presencia de un abogado.

Ninguno de los agentes presentes en el lugar de los hechos presentaron orden de detención alguna. Sin embargo, el Departamento de Policía de Nueva York confirmó que había utilizado tecnología de reconocimiento facial.

El caso de Dwreck, y otros cercanos al movimiento Black Lives Matter, ponen de manifiesto lo peligroso que puede llegar a ser el uso de esta tecnología.

Ten cuidado, se han quedado con tu cara. Pero no solo manifestantes son objeto de este tipo de vigilancia.

El impacto discriminatorio del reconocimiento facial va mucho más allá y cualquier persona puede verse afectada.

También en Nueva York, los propietarios de inmuebles de alquiler no dudan en utilizar esta tecnología para espiar a los residentes.

Los habitantes de Atlantic Plaza Towers de Ocean Hill-Brownsville, en Brooklyn, evitaron la instalación de cámaras de reconocimiento facial,

Fueron amenazados, pero no cedieron. Tras una larga batalla judicial para detener esta invasión de su privacidad y el robo de los datos biométricos de quienquiera que entrara en los edificios.

En noviembre de 2019 el grupo propietario anunció en una reunión de la asociación de inquilinos que desistía de instalar el sistema de reconocimiento facial.

Los casos de Derrick Ingram y de los residentes de los edificios Atlantic Plaza Towers son solo ejemplos de los riesgos que conlleva el uso de tecnología de reconocimiento facial en relación al derecho a la privacidad

Una tecnología que escanea y recopila datos de todos los rostros que se encuentran dentro de su radio y que no es necesaria o proporcionada en ninguna circunstancia.

Para que se queden con tu cara, es importante recordar que las normas internacionales de derechos humanos establecen tres condiciones.

Estas condicionesw han de cumplirse para determinar si una injerencia en el derecho a la privacidad es legítima o constituye una violación de derechos humanos.

Pienso que en primer lugar, toda injerencia debe estar prescrita por ley y ajustarse a la ley; en segundo lugar, debe perseguir un fin legítimo.

Y debe ser estrictamente necesaria para lograr un fin legítimo, como proteger la seguridad nacional o el orden público y llevarse a cabo de manera proporcionada a ese fin.

Los Estados recurren cada vez más a esta tecnología para controlar manifestaciones y quedarse con su cara, dificultando el derecho de reunión pacífica y el derecho a la libertad de expresión.

En palabras del relator especial de la ONU sobre la promoción y protección del derecho a la libertad de opinión y de expresión, David Kaye:

“En entornos sometidos a una vigilancia ilícita generalizada, las comunidades vigiladas conocen o sospechan de tales actividades, lo que a su vez perturba y restringe su capacidad para ejercer sus derechos a la libertad de expresión [y de] asociación”.

Dicho de otro modo, el uso de la tecnología de reconocimiento facial puede actuar como un elemento disuasorio de doble filo.

Ya que al interrumpir tanto las reuniones pacíficas en espacios públicos como la documentación de posibles abusos, desincentivando gravemente esas formas de disidencia pacífica en un futuro próximo.

El reconocimiento facial puede afectar de forma desproporcionada a los grupos marginados y menoscabar el derecho a la igualdad y a no sufrir discriminación.

Un derecho que sustenta el resto de derechos humanos.

El reconocimiento facial puede dar lugar a la elaboración de perfiles sobre la base de la etnia, la raza, el origen nacional, el género y otras características, que constituyen motivos ilícitos de discriminación.

Por ejemplo, en China se quedan con tu cara muy a menudo. Las autoridades estatales han usado tecnologías de reconocimiento facial como elemento fundamental de su aparato tecnológico para crear un Estado de vigilancia en la región Autónoma Uigur de Sinkiang

Aquí los sistemas de tecnología de reconocimiento facial se usan para efectuar un rastreo exhaustivo de la población uigur.

Con este fin, la tecnología de reconocimiento facial corre el riesgo de ser usada para diferenciar a las personas en función de características protegidas. Y, como ocurre en China, para actuar contra estos grupos y perseguirlos.

La batalla en defensa de los derechos humanos no se libra solo en la calle. Un nuevo ámbito, el ámbito digital, también requiere de protección.

Amnistía Internacional ha lanzado la campaña Ban The Scan (Prohíban el escaneo) en la que pide la prohibición del uso de los sistemas de reconocimiento facial como forma de vigilancia masiva por parte de agencias estatales y otros actores del sector privado, actores que “se quieren quedar con nuestra cara”.

Hoy, en pleno 2021, está de máxima actualidad: Es lo que nos dicen en silencio las miles de cámaras que llenan nuestras calles.

Fuente: Carlos de las Heras (@carlisevic). Responsable de tecnología y derechos humanos,